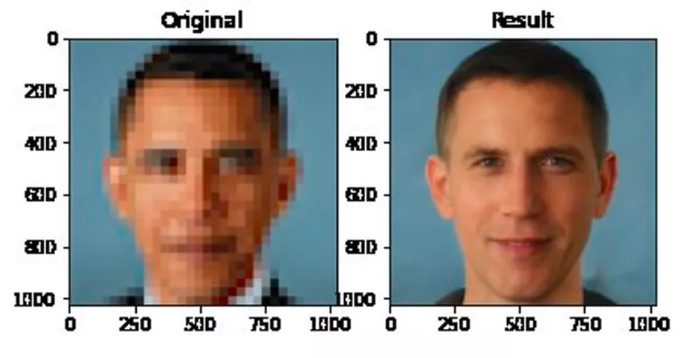

这是一个惊人的图像,说明了AI研究的根深蒂固的偏见。将美国第一任黑人总统巴拉克·奥巴马(Barack Obama)的低分辨率图片输入到旨在生成去像素脸部的算法中,然后输出的是白人。

也不仅仅是奥巴马。获取相同的算法,以从低分辨率输入生成女演员露西·刘或女议员亚历山大·奥卡西奥·科尔特斯的高分辨率图像,并且所产生的面孔看起来明显是白色的。正如一则流行的推文援引奥巴马的例子所言:“这张图片充分说明了人工智能存在偏见的危险。”

但是,是什么原因导致这些输出的呢?它们真正告诉我们关于AI偏差的什么信息?

首先,我们需要对这里使用的技术有所了解。生成这些图像的程序是称为PULSE的算法,该算法使用一种称为“放大”的技术来处理视觉数据。升级就像在电视和电影中看到的“缩放和增强”这样的比喻,但是与好莱坞不同,真实的软件不能仅仅从无到有地生成新数据。为了将低分辨率图像转换成高分辨率图像,该软件必须使用机器学习来填补空白。

对于PULSE,执行这项工作的算法是StyleGAN,它是由NVIDIA研究人员创建的。尽管您以前可能没有听说过StyleGAN,但您可能对它的工作很熟悉。这是负责制作那些怪异逼真的人脸的算法,您可以在ThisPersonDoesNotExist.com等网站上看到这些人脸;如此真实的面孔经常被用来制作虚假的社交媒体资料。

PULSE所做的是使用StyleGAN“想象”高分辨率版本的像素化输入。它不是通过“增强”原始的低分辨率图像来实现此目的,而是通过生成一个全新的高分辨率面(当像素化时看起来与用户输入的像相同)。

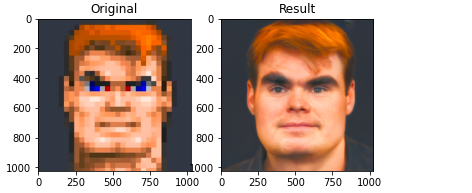

这意味着可以以多种方式放大每个去像素的图像,就像使用一组配料制作不同的菜肴一样。这也是为什么您可以使用PULSE来查看《毁灭战士》,《德军总部3D》的英雄,甚至是哭泣的表情符号在高分辨率下的样子的原因。并不是说算法会像“缩放并增强”底片那样“寻找”图像中的新细节。而是发明新的面孔以还原为输入数据。

从理论上讲,这种工作已经进行了几年,但是,就像AI界经常发生的那样,当这个周末在网上共享了易于运行的代码版本时,它就吸引了更多的听众。那是种族差距开始扩大的时候。

PULSE的创建者说趋势很明显:当使用该算法按比例放大像素化图像时,该算法通常会生成具有白种人特征的人脸。

该算法的创建者在Github上写道:“看起来PULSE产生白色面孔的频率要比有色人种的面孔高得多。”“这种偏见很可能是从StyleGAN接受过数据集训练而来的,尽管可能还有其他我们不知道的因素。

换句话说,由于对StyleGAN进行了数据训练,因此当试图绘制看起来像像素化输入图像的人脸时,它默认为白色特征。

这个问题在机器学习中极为普遍,这也是面部识别算法在非白人和女性脸上表现较差的原因之一。用于训练AI的数据通常偏向一个人口统计学的白人,并且当程序看到不在该人口统计学中的数据时,其性能就会很差。并非巧合的是,白人主导着AI研究。

但是,奥巴马的例子所揭示的关于偏见的确切内容以及它所代表的问题可能如何得到解决都是复杂的问题。实际上,它们是如此复杂,以至于单一图像引发了AI学者,工程师和研究人员之间的激烈争论。

从技术上讲,一些专家不确定这是否是数据集偏差的一个示例。AI艺术家Mario Klingemann认为,应该归咎于PULSE选择算法本身,而不是数据。克林格曼指出,他能够使用StyleGAN从相同的像素化奥巴马图像生成更多非白色输出,如下所示:

克林格曼说,这些人脸是使用“相同的概念和相同的StyleGAN模型”生成的,但使用的搜索方法与Pulse不同,他说,我们不能仅仅从几个样本中真正判断出一种算法。他告诉The Verge:“可能有数以百万计的可能的面孔都将缩小为相同的像素模式,而且所有这些面孔都是’正确的’。”

(顺便说一下,这也是为什么这样的工具不太可能用于监视目的的原因。这些过程创建的面孔是虚构的,并且如上面的示例所示,与输入的基本事实无关。但是, ,这并不是说过去巨大的技术漏洞已阻止警察采用技术。)

但是,无论原因如何,算法的输出似乎都是有偏差的-在该工具广泛可用之前,研究人员并未注意到这一点。这说明了一种不同且普遍存在的偏见:一种在社会层面上起作用的偏见

资料来源:什么样的机器学习工具会使奥巴马白皙